Die rasante Weiterentwicklung der KI-Branche hat einen neuen Meilenstein erreicht – OpenAIs neueste Entwicklung verwandelte Texteingaben in Videos, welche man großteils kaum mehr von den bislang typischen KI-Werken unterscheiden kann. Deren bekannte Fehler wie Hände mit zu vielen oder zu wenigen Fingern, Artefakten, Verstößen gegen die Regeln der Physik und weitere scheinen weitgehendst ausgemerzt. Was du dazu wissen solltest und wie Sora eingeordnet werden kann, erfährst du in diesem Beitrag.

Gamechanger oder Fake?

Sora ist die neueste Entwicklung aus dem Hause OpenAI: Aus Textpromts werden Videos. Auf der offiziellen Webseite finden sich rund 50 Videos, in denen die Macht des neuen Werkzeugs demonstriert wird. Das Unternehmen beteuert proaktiv, dass alle Videos unbearbeitet von Sora generiert wurden. Das kommt nicht von ungefähr – erst Ende 2023 hat Google ein beeindruckendes Video von der eigenen KI gezeigt. Es wurde nachbearbeitet, laut Google um die Abläufe beschleunigt darzustellen. In Wahrheit wurde jedoch deutlich mehr manipuliert, wie der Konzern später zugeben musste.12

Und auch sonst ist bei KI-Ankündigungen Vorsicht geboten. Spätestens seit ChatGPT handelt es sich um das aktuelle Hypethema. Natürlich möchte das jeder von sich behaupten können, schon alleine um beim Buzzword-Bingo mitzuspielen. Hatten wir mit anderen Themen ja ebenfalls. Eine Zeit lang hat jeder, der halbwegs beachtet werden wollte, irgendwas mit Blockchain gemacht. Nun ist KI dran. Es sollte daher nicht verwundern, dass in manchen Anwendungen gar keine KI drin steckt, nur weil das drauf steht.3 Zumal der Begriff dehnbar ist: Ab wann ist ein komplexer Algorithmus nicht mehr bloß ein komplexer Algorithmus, sondern darf sich mit den magischen zwei Buchstaben schmücken? Etwas abkühlende Skepsis in der überhitzten Hype-Blase ist daher grundsätzlich mehr als angebracht. Statt getreu dem Motto „KI ist, was wir nicht verstehen“ zu verfahren.4

Das macht Sora so beeindruckend

Glauben wir OpenAI, scheint ein neuer Meilenstein erreicht. Zwar können Videos mit entsprechender Rechenleistung bereits generiert werden, wie z.B. eine inszenierte Bierflut auf dem Oktoberfest zeigt.5 Solche Videos konnten bisher schnell als Fälschung entlarvt werden: Gesichter wirken verschwommen bzw. entstellt, Gebäude verschwinden plötzlich auf unnatürliche Weise und insbesondere in Menschenmassen sehen Menschen die sich berühren schnell aus, als wären sie miteinander verwachsen. Dazu fehlen gerne Körperteile, auch bei Schatten ignorierten KIs gerne die Regeln der Physik. Man könnte noch mehr Details nennen, kurzum: Hier sieht wohl noch jeder spätestens beim zweiten Blick, dass dieses Video mindestens Manipuliert sein muss.

Doch bei Sora ist das anders: Die Videos sind generell in einer sehr hohen Qualität und wirken realistisch.6 Wasser bewegt sich korrekt, inklusive Selbst Menschen haben ein klar erkennbares Gesicht mit vielen Details wie z.B. Barthaaren. Ein Video treibt dies sogar auf die Spitze: Es zeigt ein menschliches Auge in Nahaufnahme.

Wie ist das möglich?

Laut OpenAI wurde Sora speziell auf Bewegungen in der physischen Welt optimiert. Das Modell soll verstehen, wie sich Objekte verhalten und wie Emotionen aussehen. Der Konzern relativiert das später selbst wieder: Bei komplexen Szenen kann die Physik nicht passen. Oder es gibt Schwierigkeiten, bestimmte Folgen von Handlungen sichtbar zu machen. Als Beispiel wird eine Person genannt, die in einen Keks beißt, ohne Bissspuren. Technisch soll es sich um ein Diffusionsmodell handeln, d.H. Einzelbilder mit Rauschen, das in mehreren Schritten zum gewünschten Promt hin entfernt wird.78

Die Architektur und Daten bleiben proprietär. Nur OpenAI weiß also, wie das System im Detail funktioniert, welche Trainingsdaten verwendet wurden usw. Das ist ein negativer Trend, den OpenAI leider bereits mit dem GPT-4 Sprachmodell von ChatGPT eingeführt hat. Netzpolitik.org umschrieb den 180 Wandel mit OpenAI ist jetzt ClosedAI – treffender geht kaum.9

Ist Sora unfehlbar?

Der KI ein wirkliches Verständnis zu unterstellen, halte ich für eine gewagte Aussage. Chatbots präsentieren ja gerade aus dem Grunde immer wieder erfundene Informationen verblüffend realistisch, weil sie kein Verständnis haben.1011 Sie basieren auf Wahrscheinlichkeitsrechnung mit einem gewissen Kontext. Ein Chatbot hat jedoch keine Ahnung, dass die Aussage „Die Welt ist eine Scheibe“ völliger Blödsinn ist. Wenn das in den Quelldaten oft genug vor kommt, wird der Chatbot das sagen.12 Und einen seriös klingenden Kontext dazu dichten, welcher renommierte Wales-Professor nach ausführlicher Untersuchung die Scheibenform bewiesen hat.

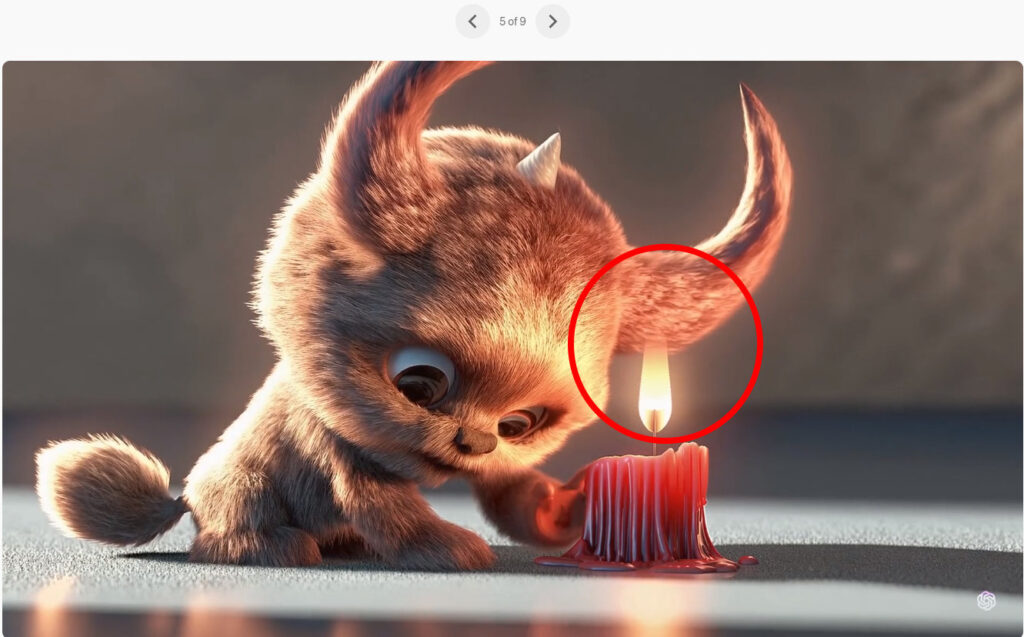

Bei einem Video wirkt es so, als würde das Tier sein Horn in die Kerzenflamme halten, aber es brennt nicht. Es ist aus dieser Perspektive heraus schwer zu sagen, ob es sich kurz davor befindet. Abgesehen davon sind mir keine typischen KI-Fehler aufgefallen, nicht mal im Ansatz.

In anderen Videos habe ich ähnliche kleinere Details gefunden. Beispielsweise läuft ein Tier an der Figur vorbei und verschwindet plötzlich im nichts. Bei der Menge hält sich das allerdings sehr in Grenzen. Es ist nicht vergleichbar mit der Masse an Fehlern, die bisher in künstlich generierten Videos offenkundig waren. Offensichtliche Fehler sind mir nur an einem Video aufgefallen: Es zeigt im Sand buddelnder Männer, die plötzlich eine Pappe aus dem Boden ziehen, unter der ein Plastikstuhl erscheint. Dieser Stuhl schwebt erst, dann bewegt er sich und verformt sich am Ende.13

Es sieht nicht danach aus, als sei Sora die perfekte KI, auf die alle gewartet haben. Sondern eher die nächste Generation. Das soll die Leistung nicht streitig machen: Die gezeigten Ergebnisse sind beachtlich und ein Sprung nach vorne. Allerdings holt es uns wieder auf den Boden der Tatsachen – weg von einer Illusion, in der KI versteht was sie tut, was die Grundlage für perfekte Ergebnisse wäre.

Wie kann ich Sora nutzen?

Sora kann derzeit nur kürzere Videos von maximal einer Minute generieren und ist noch nicht für die Öffentlichkeit freigegeben. Lediglich ein sehr kleiner Kreis des sogenannten „Red Team“ kann es derzeit nutzen.14 Neben den Beispielen auf der Webseite veröffentlichte Sam Altman, der CEO von OpenAI auf X/Twitter mehrere generierte Videos, deren Promts von Internetnutzern vorgeschlagen wurden.15

Ich sehe derzeit keinen Grund zur Annahme, dass die offiziellen Videos manipuliert wurden. Dennoch sollte klar sein: Das sind ausgewählte Beispiele, weil man sich natürlich in gutem Licht darstellen möchte. Alleine damit ist es damit schwer abzuschätzen, wie mächtig Sora wirklich im Detail sein wird. Doch eines scheint spätestens jetzt absehbar: Wir werden bald auch Videos wohl nicht mehr trauen können.

Darauf sind wir nicht vorbereitet

Bereits die relativ neuen Chatbots wie ChatGPT & co. stellen unsere Gesellschaft vor neue Herausforderungen.16 Nun sind wir nach den Bildern schon bei Videos. Derzeit wird dort noch oft echtes Material aus dem Kontext gerissen. Beispielsweise um zu behaupten, Szenen die bereits vor Jahren an anderer Stelle geschehen sind, zeigen einen aktuellen Krieg.

Es ist nur eine Frage der Zeit, bis hochqualitative, sehr schwer bis gar nicht erkennbare KI-Videos breitflächig verfügbar sind. Bereits heute kann ein Raspberry Pi für unter 100€ authentische Bilder erzeugen. Wir stehen bei alle dem erst am Anfang, wie beispielsweise das Bild des Papstes im Daunenmantel Anfang 2023.17 Schaut man sich die Medienkompetenz an, ist ein erheblicher Teil bereits mit den klassischen digitalen Medien überfordert. Bei einer 2021 durchgeführten Studie erreichten die Teilnehmer durchschnittlich weniger als die Hälfte der möglichen Punkte. Bei 46% der Teilnehmer wurde eine sehr geringe Nachrichten- und Informationskompetenz festgestellt.18

Man kann sich ausmalen, wie viele davon einem gefälschten Video in der Qualität der gezeigten Beispiele von Sora Glauben schenken würden, wenn nur knapp 1/3 eine Kolumne erkennt und gerade mal 7% die Advertorial Werbekennzeichnung. Zumal Menschen visuelle Wesen sind. Wir bewerten etwas, das wir mit den eigenen Augen gesehen haben, anders als z.B. Text.

Andere auch nicht

Und wie viel man mit einer Flut an fragwürdigen bis falschen Informationen erreichen kann, demonstrierte Donald Trump: Fast 1/4 der US-Amerikaner glaubte 2021, dass die Wahl ihm 2020 gestohlen wurde – das heißt, Trump wurde Opfer von Wahlmanipulation.19 Obwohl er das nicht belegen konnte, wiederholte er diese Behauptung ständig. Was würde passieren, wenn Joe Biden in einem Video erklärt, Trump wurde betrogen und sei rechtmäßiger Präsident? Den von Trump unterstützten Sturm aufs Kapitol hatten wir bereits ohne künstlich erzeugte Videos. KI-Inhalten wird zudem tendenziell eher geglaubt.20 Wir sind also nicht als einzige schlecht Vorbereitet, das Thema ist größer.

Der Weg in die Politik und Gesellschaft ist bereits in vollem Gange

Dieses Machtpotenzial um den öffentlichen Diskurs manipulieren zu können, trat bereits Anfang 2023 in Erscheinung. Im Internet kursierte ein Bild von Donald Trump, das ihn bei seiner angeblichen Verhaftung durch etliche Polizisten zeigt.21 Grundsätzlich mag das nicht unrealistisch erscheinen: Der ehemalige US-Präsident ist mittlerweile in über 80 Punkten angeklagt. Doch das Bild war gefälscht, eine AI hat es generiert. Bis heute pendelt Trump als freier Mann von Gerichtsprozess zu Gerichtsprozess. Es ließ sich leicht anhand typischer KI-Fehler erkennen, wie z.B. Hände mit vier Fingern.

Es sollte nur wenige Monate dauern, bis das Zentrum für politische Schönheit die Macht von Deepfakes am Bundeskanzler Olaf Scholz demonstriert: Dieser verkündete in einer Videobotschaft das angebliche Verbot der AfD.22 Auch das hat jedoch nie stattgefunden – zum Ärger der Regierung, die dagegen vorgeht.

Aktuell wurde Taylor Swift das Opfer einer weiteren Art von KI-Missbrauch: Zahlreiche Internetnutzer generierten pornografische Deepfakes von der Sängerin. Dies schlug derart hohe Wellen, dass sich sogar das Weiße Haus zu Wort meldete.23 Die Welle an Material entstand durch einen Wettbewerb, bei dem es darum ging, die Sicherheitsmechanismen in Clouddiensten zu umgehen.24 Diese Schutzmechanismen sind ein ewiges Katz-und-Maus-Spiel: Weil sich KI-Entscheidungen schwer bis gar nicht nachvollziehen lassen, kann man ihnen kaum wirkungsvoll ein bestimmtes Verhalten verbieten.25

Das Interesse an der Generierung von Nacktdarstellungen mit solchen Diensten ist gestiegen.26 Spätestens hier sind wir in einem Bereich, der jeden potenziell betrifft. Man stelle sich vor, wie rachsüchtige Personen z.B. solche Medien generieren und an den Partner/die Partnerin senden, um angebliche Untreue zu belegen – die nie stattgefunden hat. Oder ein Video, in dem man den Chef beleidigt – die Möglichkeiten sind groß.

Fazit: Wir sollten aufholen

Der technische Wandel vollzieht sich durch gigantische Investitionen derzeit weitaus schneller, als die Gesellschaft darauf vorbereitet ist. Unter Hollywood-Schauspielern gab es unter anderem wegen KI bereits große Streiks.27 Aber auch hierzulande haben Unternehmen wie z.B. SAP angekündigt, 8.000 Mitarbeiter mit KI ablösen zu wollen.28 Es ist aus meiner Sicht unerlässlich, die Gesellschaft bei dieser Entwicklung mitzunehmen. Das fängt bei der Sicherung ihrer Existenz an: Ohne zumindest ein bedingungsloses Grundeinkommen sorgen sich Menschen durchaus nachvollziehbar darum, ob sie in ein paar Jahren noch von ihrer Lohnarbeit leben können.29 Und endet bei der Medienkompetenz, wo wir nach wie vor sehr viel Nachholbedarf haben.

Realistische Alternativen gibt es dazu nicht. Ob wir KI mögen oder nicht, spielt schlussendlich keine wichtige Rolle. Selbst wenn wir es wollten, können weder Forschung noch Technologie wirkungsvoll verlangsamt oder gar verboten werden. Was wir aber tun können, ist uns vorzubereiten und Rahmenbedingungen festzulegen. Verpassen wir das, wird uns Technik irgendwann überrollen. Einige Probleme sind ja keineswegs neu, sondern wachsen bereits seit Jahren. KI hat sie nicht verursacht, sondern ist die nächste Entwicklungsstufe, die sich missbrauchen lässt – wie vieles andere auch.

Quellen

- https://winfuture.de/news,140024.html ↩︎

- https://www.giga.de/news/google-gibt-zu-spektakulaeres-ki-video-ist-ein-fake/ ↩︎

- https://www.notebookcheck.com/Der-aktuelle-Alles-ist-KI-Wahnsinn-Auch-der-popeligste-alte-Algorithmus-wird-umgetauft.794436.0.html ↩︎

- https://www.heise.de/news/Ester-Dyson-KI-ist-was-wir-nicht-verstehen-9596770.html?wt_mc=rss.red.unbekannt.unbekannt.rdf.beitrag.beitrag ↩︎

- https://twitter.com/micha/status/1685591235812081664 ↩︎

- https://www.br.de/nachrichten/netzwelt/sora-von-openai-ueber-diesen-film-generator-staunt-die-ki-welt,U4RAN1s ↩︎

- https://openai.com/research/video-generation-models-as-world-simulators ↩︎

- https://1e9.community/t/der-neue-video-generator-von-openai-erzeugt-szenen-die-von-der-realitaet-kaum-zu-unterscheiden-sind/20055 ↩︎

- https://netzpolitik.org/2023/ki-forschung-openai-ist-jetzt-closedai/ ↩︎

- https://www.watson.ch/digital/review/325210816-ki-chatbot-von-microsoft-entpuppt-sich-als-manipulativer-luegner ↩︎

- https://www.heise.de/news/ChatGPT-erfindet-Gerichtsurteile-US-Anwalt-faellt-darauf-herein-9068180.html ↩︎

- https://www.stern.de/digital/online/chatgpt–forscher-ueberfuehren-die-hype-ki-beim-bewussten-luegen-34256890.html ↩︎

- https://twitter.com/charliebholtz/status/1758200919181967679 ↩︎

- https://openai.com/blog/red-teaming-network ↩︎

- https://twitter.com/sama/media ↩︎

- https://www.br.de/nachrichten/netzwelt/chatgpt-und-co-informatikerin-fordert-ki-fuehrerschein,U146fDK ↩︎

- https://www.br.de/nachrichten/netzwelt/virales-papst-foto-ist-fake-so-taeuscht-kuenstliche-intelligenz,TZgc2dq ↩︎

- https://www.spiegel.de/kultur/digitale-medienkompetenz-in-deutschland-studie-liefert-beunruhigende-ergebnisse-a-13624abd-cd41-4541-9cf1-7f4ff822d0e0 ↩︎

- https://www.spiegel.de/ausland/us-wahl-2020-fast-ein-viertel-der-amerikaner-haelt-wahl-fuer-gestohlen-a-1ab5edda-8a4b-42b2-85eb-f30b1012031b ↩︎

- https://www.deutschlandfunk.de/die-reale-gefahr-automatisierter-fake-news-dlf-e50c5c59-100.html ↩︎

- https://arstechnica.com/tech-policy/2023/03/fake-ai-generated-images-imagining-donald-trumps-arrest-circulate-on-twitter/ ↩︎

- https://fahrplan.events.ccc.de/congress/2023/fahrplan/events/12345.html ↩︎

- https://www.heise.de/news/Taylor-Swift-KI-generierte-pornografische-Bilder-loesen-politische-Debatte-aus-9610957.html ↩︎

- https://www.heise.de/news/KI-Challenge-Pornographische-Deepfakes-von-Taylor-Swift-Teil-eines-Wettbewerbs-9619833.html ↩︎

- https://www.heise.de/news/Bericht-NIST-warnt-vor-vergifteten-KI-Systemen-und-zeigt-Schutzmassnahmen-auf-9591806.html?wt_mc=rss.red.security.security.rdf.beitrag.beitrag ↩︎

- https://www.heise.de/news/KI-Anwendungen-zur-Entkleidung-von-Fotos-boomen-ganz-sichtbar-im-Internet-9570479.html ↩︎

- https://www.tagesspiegel.de/kultur/mehr-geld-regelung-des-einsatzes-von-ki-schauspieler-in-hollywood-beenden-streik-und-einigen-sich-mit-studios-10753603.html ↩︎

- https://www.n-tv.de/wirtschaft/Kuenstliche-Intelligenz-soll-8000-Mitarbeiter-bei-SAP-ersetzen-article24684800.html ↩︎

- https://www.rnd.de/medien/ki-ersetzt-kuenstliche-intelligenz-bald-schauspieler-D6WFT2E7VFB6JHC7VEUS7K3HQU.html ↩︎