Die Empörung ist groß über Microsofts aktuellste Dimension zur Zerstörung von Privatsphäre und Sicherheit. Doch nun zeigt sich: Der Konzern hat über Sicherheitsmerkmale gelogen – die Funktion ist noch weitaus gefährlicher, als bisher angenommen. Was genau bekannt wurde und was der Konzern in Zukunft vor hat, fasst dieser Beitrag zusammen.

Recall: Die nächste Stufe der Überwachung

Microsoft setzt voll auf maschinelles Lernen – vermarktet unter dem Buzzword „Künstliche Intelligenz“, kurz „KI“. Erst vor wenigen Wochen hat der Konzern „Recall“ als Teil von Copilot+ vorgestellt. Es soll im Sekundentakt automatisiert Bildschirmfotos anlegen, die maschinell verarbeitet werden. Der Nutzer kann diese gespeicherten Daten später durchsuchen und soll somit Inhalte über Anwendungsgrenzen hinweg wiederfinden. Es spielt keine Rolle mehr, ob z.B. ein Artikel im Browser, RSS-Feed oder dem News-Widget gelesen wird.

Bereits das verschärft die Überwachung noch einmal deutlich, wie ich in diesem Beitrag ausführlicher erklärt habe. Sicherheitsforscher warnen vor verschiedenen Missbrauchsszenarien. Eines davon ist Schadsoftware: Sie könnte alles nachvollziehen, was der Anwender in den letzten Monaten gemacht hatte. Beispielsweise sensible Daten abgreifen, da Recall diese nicht schützt. Lediglich urheberrechtlich geschützte und mit DRM in unfreie Inhalte verwandelte Medien sind von der Erfassung ausgeschlossen. Dazu dazu hat Microsoft seit Jahren durch schwere Pannen, Sicherheitsmängel und weitere Versäumnisse einen schlechten Ruf. Außerdem sind sie dafür bekannt, den Nutzern ihre „Funktionen“ aufzuzwängen. Recall ist da keine Ausnahme: Es wird auf unterstützten PCs standardmäßig aktiviert sein.

Recall „gehackt“, bevor es offiziell erschienen ist

Offiziell ist Recall noch nicht frei verfügbar, weil nur ausgewählte ARM-Prozessoren unterstützt werden. Diese sind für die zweite Hälfte des Juni 2024 angekündigt. Inzwischen haben ARM-Nutzer über Tricks Recall auch auf Geräten zum Laufen gebracht, die Microsoft nicht offiziell unterstützt. Dafür gibt es ein quelloffenes Projekt auf GitHub.1 Künstlich hohe Systemanforderungen sind seit Windows 11 Standard. Der Konzern erlaubt einen Teil davon zu umgehen, allerdings auf eigenes Risiko. Manche Werkzeuge haben dies zur Vereinfachung bereits eingebaut, etwa Rufus.

Die Analyse ist erschütternd: Microsoft lässt eine OCR Texterkennung über die Bildschirmfotos laufen und speichert deren Daten inklusive Meta-Informationen in einer SQLite-Datenbank.23 Sie ist für jeden Administrator-Nutzer zugreifbar. Das gleiche gilt für die Bildschirmfotos. Dabei handelt es sich um Bilder, welche im Dateisystem abgelegt werden. Microsoft hat in seiner offiziellen Erklärung also gelogen.4 Dort heißt es, die Snapshots (= Screenshots) seien nicht für andere Nutzer auf dem Gerät oder für MS selbst zugreifbar. Tatsächlich können alle Administratoren darauf zugreifen, wie auf alle anderen Dateien auch.5

Nun könnte man argumentieren, ein normaler Nutzer arbeitet nicht mit Administratorrechten. Das wäre vernünftig, jedoch haben Admin-Rechte unter Windows Tradition. Das ist auch Microsoft bewusst.6 Interessiert sie jedoch offensichtlich nicht.

Microsoft hilft: Hackern gefällt das

Aus Sicht eines Angreifers sind Bildschirmfotos unhandlich – schließlich legt Microsoft etwa 720 Stück pro Stunde bei einem Intervall von 5 Sekunden zwischen den Screenshots an. Über Wochen oder gar Monate kommen somit exorbitante Datenmengen zusammen. Diese händisch nach Informationen zu durchsuchen, welche sich missbrauchen lassen, wäre viel zu aufwändig. Hier hilft Microsoft: Durch die lokale SQLite-Datenbank führt Windows eine Art Vorsortierung durch, wofür potenzielle Angreifer sehr dankbar sind.

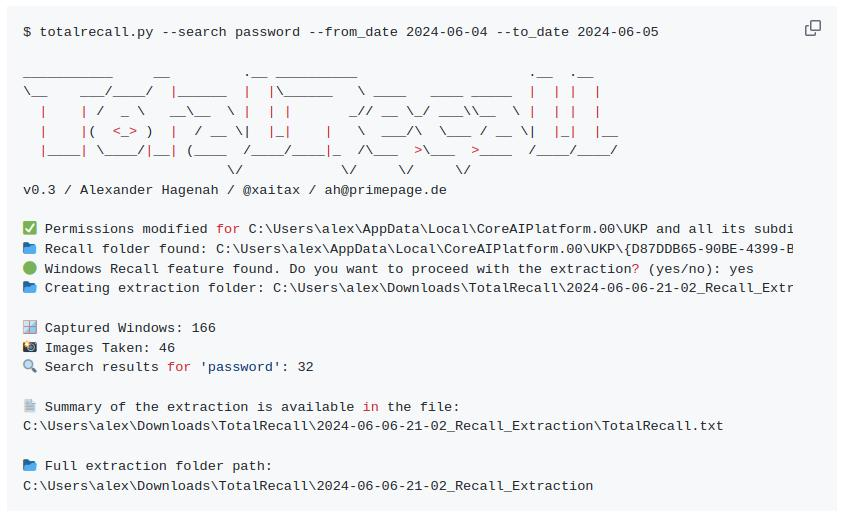

Es existiert bereits ein Python-Skript TotalRecall, welches mit lediglich etwa 160 Zeichen Code einen automatischen Zugriff auf die Datenbank ermöglichen und sie nach Stichworten durchsuchbar machen.7 In der Demonstration wird beispielsweise nach „passwort“ gesucht, um mögliche Zugangsdaten zu finden. Auch der Zeitraum lässt sich einschränken. Grundsätzlich gilt: Alles was man an einem Windows-Bildschirm gesehen hat, landet später als Klartext in der Datenbank.

Wie geht es mit Recall weiter?

Die Vorstellung von Recall hat bereits zu breiter Empörung geführt: Microsoft zerstört Sicherheit und Vertrauen damit noch viel stärker, ist der Tenor. Anfangs versuchte der Konzern, die Kritik auszusitzen. Der Druck ist jedoch so groß geworden, dass sie tatsächlich ein Stückchen zurück rudern – das passiert dort selten. In einem Blogeintrag vom 07.06.2024 haben sie im Kern zwei Änderungen vorgenommen. Zunächst wird die Gängelung gelockert. Microsoft aktivierte Recall bisher automatisch. Zukünftig soll der Nutzer gefragt statt übergangen werden. Sogar ohne Dark Patterns, die das Unternehmen bei der Einrichtung von Windows ansonsten massig einsetzt, um Nutzer zu gängeln.

Zusätzlich möchte man nun die Daten schützen: Windows Hello ist für Aktivierung und Zugriff nötig, d.H. es wird biometrische Authentifizierung (Gesicht/Fingerabdruck) oder ein Pin benötigt. Die Bildschirmfotos sowie Datenbank soll zudem verschlüsselt werden.8 „We built privacy and security into Recall’s design from the ground up.“ stimmte also offensichtlich auch nicht – mit diesen Worten hat der Konzern selbst Recall vorgestellt.

Fazit: Microsoft hat sich selbst vorgeführt

Wenige Wochen bevor Recall erschien, versprach Microsofts Chef hoch und heilig, Sicherheit an erster Stelle zu stellen.9 Das sagt vieles über den Konzern aus – erst einmal, dass bisher Sicherheit nicht so wichtig war. Zwar kann das jeder an den regelmäßigen gravierenden Sicherheitsmängeln in Microsoft-Software sehen. Der warb und wirbt allerdings trotzdem mit der rosaroten Brille, wie sicher man doch sei. Scheint Tradition zu haben, bei Copilot haben sie es ja genau so gemacht: Lügen was von total sicher herbei, bis sie von der Realität eingeholt werden. Der „Jetzt aber wirklich“ Anlauf war ebenfalls ein Reinfall. Nicht nur durch Recall, auch in der Azure-Cloud weigert sich Microsoft mal wieder, ihre Sicherheitsmängel auszubessern.10

Dieses Unternehmen hat einmal mehr bewiesen, weder Sicher noch Ehrlich zu sein. Wer immer noch deren Produkte kauft, unterstützt diese Praktiken und sollte ernsthaft überlegen, ob er das mitmachen sowie seinen Daten antun möchte. Schließlich sind es eure Daten, die kompromittiert werden, wenn Copilot & co z.B. die Ende-zu-Ende-Verschlüsselung umgehen.

Quellen

- https://github.com/thebookisclosed/AmperageKit ↩︎

- https://winfuture.de/news,143172.html ↩︎

- https://mastodon.social/@detective/112513529733646088 ↩︎

- https://support.microsoft.com/en-us/windows/privacy-and-control-over-your-recall-experience-d404f672-7647-41e5-886c-a3c59680af15 ↩︎

- https://arstechnica.com/ai/2024/06/windows-recall-demands-an-extraordinary-level-of-trust-that-microsoft-hasnt-earned/2/ ↩︎

- https://www.microsoft.com/en-us/security/blog/2024/05/20/new-windows-11-features-strengthen-security-to-address-evolving-cyberthreat-landscape/ ↩︎

- https://github.com/xaitax/TotalRecall ↩︎

- https://blogs.windows.com/windowsexperience/2024/06/07/update-on-the-recall-preview-feature-for-copilot-pcs/ ↩︎

- https://www.theverge.com/24148033/satya-nadella-microsoft-security-memo ↩︎

- https://www.borncity.com/blog/2024/06/06/tenable-entdeckt-kritische-schwachstelle-in-microsoft-azure-unternehmen-will-nicht-patchen-juni-2024/ ↩︎